文章目录:

引言

在当今这个高速发展的科技时代,人工智能(AI)和机器学习已经成为了许多领域的关键技术,从自动驾驶汽车到语音助手,从智能医疗到金融风控,它们正以惊人的速度改变着我们的日常生活和工作方式。然而,在这些领域取得如此显著成果的背后,计算能力和硬件发展的进步起着至关重要的作用。正是这些关键技术的突破,为AI和机器学习提供了强大的动力,使得它们能够在各个方面发挥出巨大的潜力。

本文将重点探讨计算能力与硬件发展在AI和机器学习中的作用,以及它们如何推动这些领域取得突破性的进展。首先,我们将介绍计算能力与硬件发展的概念,并回顾AI与机器学习的基本原理。接着,我们将深入剖析计算能力与硬件发展如何影响AI和机器学习的发展,以及未来持续发展的趋势将如何进一步改变这些领域。最后,我们将讨论当前面临的挑战和前景,以及如何在确保可持续发展的同时充分发挥AI和机器学习的潜力。

计算能力与硬件发展的概念

计算能力

计算能力是指计算机系统在单位时间内进行信息处理和计算的能力。在AI和机器学习领域,计算能力对于处理海量数据、加速算法训练和优化模型至关重要。计算能力的提高意味着更快速、更高效地完成计算任务,从而在很大程度上推动了AI和机器学习技术的发展。

提高计算能力的方法主要有以下几种:

- 处理器性能的提升:随着半导体技术的进步,处理器性能持续提高,例如摩尔定律描述的晶体管数量每隔18-24个月翻一番。处理器性能的提升使得计算速度得到极大的加快,从而为AI和机器学习提供了强大的计算支持。

- 多核与并行计算:利用多核处理器和并行计算技术,可以在同一时间内处理多个计算任务,进一步提高了计算能力。这对于大规模数据处理和复杂任务的执行尤为重要。

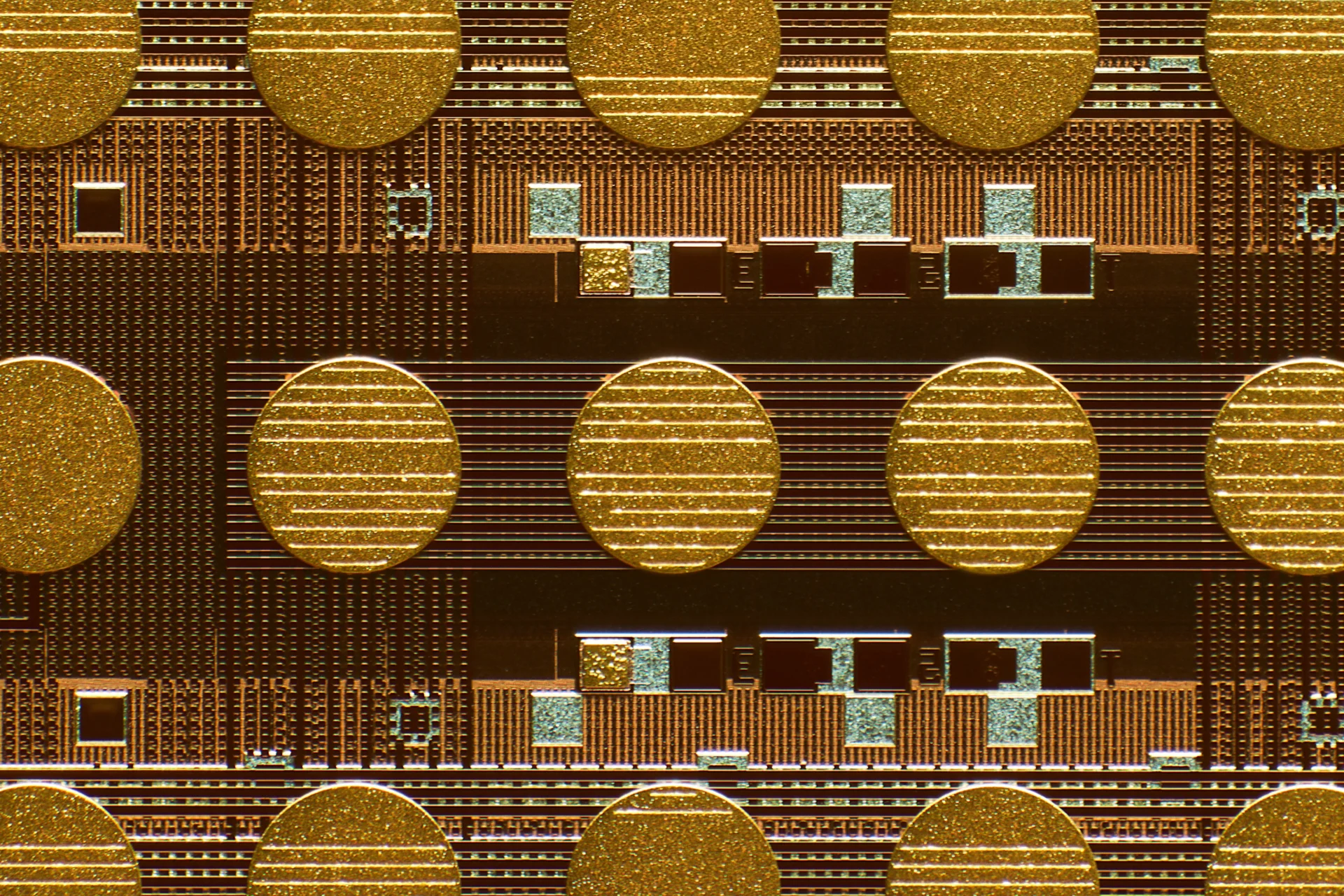

- GPU和TPU等硬件加速器:针对AI和机器学习的特殊需求,如矩阵运算和神经网络计算,专门设计的硬件加速器(如图形处理器GPU和张量处理器TPU)可以显著提高计算能力,从而加速模型训练和推理过程。

- 分布式计算:通过将计算任务分布在多台计算机上进行并行处理,分布式计算技术可以有效地提高计算能力,尤其是在处理海量数据和复杂计算任务时具有显著的优势。

计算能力在AI和机器学习中具有举足轻重的地位。随着计算能力的持续提高,未来将为AI和机器学习带来更多的可能性和应用领域。

硬件发展

硬件发展是指计算机硬件技术不断进步,以满足更高性能、更低功耗和更小尺寸等需求。硬件发展对于AI和机器学习的发展具有巨大影响,因为它为这些领域提供了更强大的计算能力和更优越的性能。以下是一些与硬件发展相关的关键驱动力和趋势:

- 半导体技术的进步:半导体技术的持续发展使得处理器、存储器和其他关键硬件组件的性能得到显著提升,同时功耗和尺寸也得到优化。例如,过去几十年来,摩尔定律驱动了晶体管密度的不断提高,从而推动了处理器性能的飞速增长。

- 专用AI硬件加速器的兴起:为了应对AI和机器学习领域特殊的计算需求,诸如GPU(图形处理器)和TPU(张量处理器)等专用硬件加速器应运而生。这些加速器针对AI和机器学习的核心任务进行了优化,如神经网络计算和矩阵运算,可以显著提高计算性能,从而加速模型训练和推理过程。

- 边缘计算和物联网设备的发展:随着物联网(IoT)的快速发展,边缘计算和智能设备变得越来越重要。这些设备通常需要在有限的资源和能耗下完成计算任务,因此对硬件性能和功耗要求很高。新一代边缘计算硬件和低功耗AI芯片为这些设备提供了强大的计算能力,使得AI和机器学习技术得以应用于更广泛的场景。

- 云计算与分布式计算:云计算和分布式计算技术使得计算资源得以更高效地共享和利用。这些技术为AI和机器学习提供了强大的计算基础设施,从而使得处理海量数据和训练复杂模型成为可能。

硬件发展为AI和机器学习的发展提供了强大的支持。未来随着硬件技术的不断进步,我们可以期待AI和机器学习在更多领域和场景中发挥巨大的作用。

计算能力与硬件发展在AI和机器学习中的作用

加速算法和模型的训练

随着计算能力和硬件发展的进步,AI和机器学习领域的算法和模型得以更快速、更高效地进行训练。在这方面,以下是一些关键的技术和方法:

- 并行计算和分布式计算:通过利用多核处理器进行并行计算或将计算任务分布在多台计算机上进行分布式计算,可以大幅提高算法和模型训练的速度。这在处理大规模数据集和复杂计算任务时尤为重要。此外,利用并行计算和分布式计算技术,研究人员可以更快地探索和优化模型结构,加速实验周期,从而更快地取得突破性成果。

- 专用AI硬件加速器:针对AI和机器学习的特殊需求,如神经网络计算和矩阵运算,图形处理器(GPU)和张量处理器(TPU)等专用硬件加速器提供了显著的性能优势。相较于传统的中央处理器(CPU),这些加速器可以在同等功耗下提供更高的计算能力,大幅缩短模型训练和推理的时间。

- 高效的优化算法:随着计算能力的提高,研究人员可以设计和实现更高效的优化算法,以在有限的计算资源和时间内找到更优的模型参数。例如,随机梯度下降(SGD)及其变种、自适应学习率算法等,能够在训练神经网络时显著提高收敛速度和模型性能。

- 模型并行与数据并行:模型并行是指在多个处理器或设备上同时训练模型的不同部分,而数据并行是指将数据集划分为多个小批次,分别在多个处理器或设备上进行计算。通过模型并行和数据并行技术,可以进一步提高模型训练的速度和效率,尤其适用于大型模型和大规模数据集的训练场景。

通过加速算法和模型的训练,计算能力与硬件发展为AI和机器学习的研究和应用提供了强大的支持。随着技术的不断进步,我们有理由相信未来的AI和机器学习技术将更加强大、更具普适性。

实现复杂任务和更大规模的数据处理

计算能力与硬件发展不仅加速了模型训练,还使得AI和机器学习能够处理更复杂的任务和更大规模的数据。以下是一些实际的数据和例子,展示了这一点:

- 深度学习模型的规模增长:随着计算能力的提高,研究人员可以训练更大规模、更深层次的神经网络,从而实现更复杂任务的处理。例如,OpenAI的GPT-3模型拥有1750亿个参数,相比前一代GPT-2(15亿参数)提升了一个数量级。这使得GPT-3在自然语言处理(NLP)任务上表现出惊人的性能,能够完成翻译、摘要、问答等多种任务。

- 图像识别的突破:计算能力的提升使得AI和机器学习能够处理更大规模的图像数据集,例如ImageNet数据集包含1400多万张图片,涵盖2万多个类别。在这种大规模数据集上训练的卷积神经网络(CNN)取得了图像识别方面的重大突破。2012年,AlexNet模型在ImageNet挑战赛上的错误率降低到了15.3%,相比前一年的26%有了显著改善,开启了深度学习在计算机视觉领域的繁荣时代。

- 语音识别的进步:随着计算能力和硬件的发展,语音识别技术在处理大规模语音数据和实现更复杂任务方面取得了显著进步。例如,谷歌的DeepSpeech 2模型可以在多种语言和口音下实现高准确率的语音识别。这种进步使得智能语音助手(如苹果的Siri和亚马逊的Alexa)得以大行其道,为我们的日常生活带来便利。

- 强化学习的突破:计算能力和硬件发展推动了强化学习算法的进步,使得AI能够在复杂的环境中实现自主学习和决策。例如,DeepMind的AlphaGo和AlphaZero分别在围棋和国际象棋等棋类游戏上取得了人类顶尖水平的成绩,这在很大程度上得益于强大的计算能力和硬件支持。此外,强化学习在无人驾驶汽车、无人机导航、机器人控制等领域也取得了显著的应用成果,展示了其广泛的潜力。

- 大规模数据处理能力:计算能力的提高使得AI和机器学习能够有效地处理大规模数据。例如,数据挖掘和推荐系统领域的算法可以在数以亿计的用户数据和商品信息中进行实时分析和预测,从而为用户提供个性化推荐。在生物信息学领域,基因组数据分析和蛋白质结构预测等任务需要处理海量的生物数据,计算能力和硬件发展使得这些任务得以实现。

- 更复杂的任务和领域:随着计算能力和硬件的不断发展,AI和机器学习正逐渐拓展到更复杂的任务和领域。例如,在金融领域,AI可以进行复杂的市场预测和风险评估,帮助企业和投资者做出更明智的决策;在医疗领域,AI可以辅助医生进行病情诊断、制定个性化治疗方案等;在自然科学领域,AI可以用于模拟和预测气候变化、探索宇宙奥秘等。

提高算法和模型的性能

计算能力与硬件发展在加速AI和机器学习算法的训练、实现复杂任务和更大规模的数据处理方面的作用外,还可以提高算法和模型的性能。以下是一些具体的例子:

- 模型优化技术:随着计算能力的提升,研究人员能够采用更多的模型优化技术,例如权重共享、稀疏连接、网络剪枝等,来减少模型的参数量、降低计算复杂度,从而提高模型的性能。这使得AI和机器学习模型在移动设备、嵌入式系统等资源受限的环境中也能够高效运行。

- 集成学习和模型融合:计算能力的提升使得研究人员可以训练多个模型并将它们集成在一起,以提高模型的整体性能。例如,在机器学习竞赛中,选手们经常使用集成学习和模型融合技术,如Bagging、Boosting、Stacking等,来提高模型的泛化能力和准确性。

- 超参数优化:计算能力的增强使得研究人员能够更加高效地进行超参数搜索和优化。例如,贝叶斯优化、遗传算法、网格搜索等方法能够在有限的时间内找到模型的最优超参数配置,从而提高模型的性能。

- 自适应算法:随着计算能力的提升,研究人员可以设计和实现更多的自适应算法,使得模型能够根据数据的特点和任务需求自动调整其结构和参数。例如,自适应学习率算法如Adam、AdaGrad等能够在训练过程中根据梯度的变化自动调整学习率,从而加速收敛过程并提高模型性能。

- 迁移学习和预训练模型:计算能力的提升使得研究人员可以训练大规模的预训练模型,并通过迁移学习技术将这些预训练模型应用到各种任务中。例如,预训练的神经网络如VGG、ResNet等在计算机视觉任务中广泛使用,而预训练的自然语言处理模型如BERT、GPT等在NLP任务中表现出色。这些预训练模型在各种任务上的性能优越,使得研究人员和工程师能够在更短的时间内构建高质量的AI应用。

- 新型算法和模型:计算能力与硬件发展为研究人员提供了更多的可能性,推动了新型算法和模型的发展。例如,神经网络的发展经历了多个阶段,从浅层神经网络到深度神经网络,再到残差网络、注意力机制等更为先进的结构。这些新型算法和模型在各种任务上的性能显著优于传统方法,为AI和机器学习的进步提供了动力。

促进新方法和技术的出现

计算能力与硬件发展不仅推动了现有AI和机器学习算法的性能提升,还为新方法和技术的出现提供了可能性。以下是一些典型例子:

- 半监督和无监督学习:随着计算能力的提升,研究人员开始探索半监督和无监督学习方法,这些方法可以在没有大量标注数据的情况下进行模型训练。例如,自编码器、生成对抗网络(GANs)、变分自编码器(VAEs)等无监督学习技术在图像生成、异常检测、数据降维等任务上取得了显著成果。

- 元学习和一次学习:计算能力的提升使得研究人员可以探索元学习和一次学习方法,这些方法旨在让模型在很少的训练数据上迅速适应新任务。例如,模型梦工厂(MAML)、记忆增强神经网络(MANN)等算法在一次学习任务上取得了良好的性能,为小样本学习问题提供了有效的解决方案。

- 强化学习的新方法:计算能力的增强使得研究人员能够探索更多的强化学习方法。例如,模仿学习、逆强化学习、分层强化学习等技术为解决现实世界中的复杂任务提供了新的思路。这些新方法在无人驾驶汽车、机器人控制、游戏AI等领域取得了显著的进展。

- 知识蒸馏和神经网络压缩:随着计算能力的提升,研究人员开始关注知识蒸馏和神经网络压缩技术,以减小模型体积和计算复杂度。这些方法使得AI和机器学习模型可以在资源受限的设备上高效运行,为边缘计算和物联网应用提供了支持。

- 量子计算与AI:计算能力的发展还为量子计算与AI的结合提供了可能性。量子计算机具有处理复杂优化问题和高维数据的潜力,这为AI和机器学习领域带来了新的机遇。虽然量子计算与AI的结合还处于初级阶段,但已经有一些研究人员开始探索在量子计算机上实现深度学习和强化学习等算法的可能性。

当前的挑战与前景

能源消耗与环境影响

尽管计算能力与硬件发展为人工智能的进步带来了许多机遇,但也面临着一些挑战和问题。其中最突出的问题是能源消耗和环境影响。随着人工智能应用的不断扩大,其对能源和环境的需求也在不断增加。

据估计,目前全球人工智能技术的能源消耗量已经相当于全球电力需求的 1%。而且,由于人工智能技术的特性,其能源消耗主要集中在训练模型和推理(inference)两个环节。这些环节需要高功率的计算设备、数据中心和存储设备,这些设备的能源消耗和碳排放对环境造成了巨大压力。

为了应对这一挑战,需要从多个方面入手,包括:

- 节能技术:研究人员正在探索各种节能技术,包括模型压缩、网络剪枝、低精度计算、模型量化等方法,以减少模型训练和推理所需的计算资源和能源消耗。

- 环境友好型硬件:研究人员正在探索更加环境友好型的硬件,包括使用可再生能源、低功率芯片、超导计算机等方法,以减少计算设备对环境造成的影响。

- 跨学科合作:能源消耗和环境问题是一个复杂的系统性问题,需要各学科之间的合作和共同努力。计算机科学、环境科学、能源工程等多个领域的专家需要共同思考和研究这一问题,寻找更加有效和可持续的解决方案。

能源消耗和环境问题是当前人工智能技术发展面临的一个重要挑战。虽然已经有一些解决方案出现,但仍需要在技术、政策和社会层面上加以推进和完善,以实现人工智能技术的可持续发展和应用。

安全性和隐私问题

随着人工智能技术的不断发展和应用,安全性和隐私问题也日益成为人们关注的焦点。在人工智能的应用中,有许多可能会泄露用户隐私的情况,例如面部识别、语音识别、行为识别等技术。此外,还存在人工智能被用于网络攻击、虚假信息传播、人工智能武器等问题,对社会和国家安全带来潜在威胁。

为了解决这些问题,需要从以下方面入手:

- 数据隐私保护:对于涉及用户隐私的应用,需要采取相应的数据隐私保护措施,例如数据加密、差分隐私、安全多方计算等技术,以保护用户的隐私权。

- 安全模型设计:在设计人工智能模型时,需要考虑安全性和隐私问题,避免模型被攻击或滥用。例如,可以采用对抗样本训练、模型鲁棒性增强等技术,以提高模型的安全性和鲁棒性。

- 监管政策制定:政府和相关机构需要加强对人工智能技术的监管和管理,建立相关的法规和政策,以保障用户的权益和社会的安全。

- 公众教育和参与:人工智能技术的安全性和隐私问题需要引起公众的关注和参与。相关机构和企业需要加强对公众的宣传和教育,让用户了解人工智能技术的安全和隐私问题,并积极参与到解决问题的过程中。

安全性和隐私问题是当前人工智能技术面临的一个重要挑战。在解决这些问题的过程中,需要从技术、政策和社会层面入手,加强各方面的合作和共同努力,以实现人工智能技术的安全、可持续和社会责任感的应用。

法律和道德伦理的挑战

随着人工智能技术的发展和应用,相关的法律和道德伦理问题也日益成为人们关注的焦点。人工智能技术的应用可能会涉及到知识产权、隐私权、公平竞争、责任分配等问题,需要建立相应的法律框架和伦理标准,以保障社会的公平、公正和可持续发展。

以下是一些可能的法律和道德伦理挑战:

- 知识产权保护:人工智能技术的发展需要大量的数据和算法,其中涉及到大量的知识产权问题。需要建立相应的知识产权保护机制,以保护数据和算法的知识产权,促进技术创新和发展。

- 道德责任和法律责任:人工智能技术的应用可能会导致不可预见的后果和风险,例如自动驾驶汽车的事故、人工智能机器人的伦理问题等。需要建立相应的道德和法律责任机制,明确人工智能技术的责任和义务,保障社会的公平和公正。

- 公平竞争和市场准入:人工智能技术的发展和应用可能会对市场竞争和公平性产生影响,例如垄断、不公平竞争等问题。需要建立相应的公平竞争机制和市场准入机制,以保障市场的公正和透明。

- 隐私保护和数据治理:人工智能技术的应用涉及大量的数据和用户隐私问题,需要建立相应的隐私保护和数据治理机制,以保护用户的隐私权和数据安全。

人工智能技术的发展和应用所涉及的法律和道德伦理问题非常复杂和多样化,需要建立相应的法律框架和伦理标准,保障社会的公平、公正和可持续发展。同时,需要加强跨领域的合作和共同努力,以实现人工智能技术的安全、可持续和社会责任感的应用。

结论

计算能力和硬件发展在人工智能和机器学习中起着至关重要的作用。这些技术的快速发展为人类创造了许多新的机遇和前景,但也面临着诸多挑战和问题。

首先,计算能力和硬件发展加速了算法和模型的训练,提高了算法和模型的性能和效率,实现了更加复杂的任务和更大规模的数据处理,促进了新方法和技术的出现。这些技术的快速发展和应用对人工智能的进步和发展起到了至关重要的作用。

然而,这些技术也面临着许多挑战和问题。其中最重要的问题是能源消耗和环境影响,安全性和隐私问题,以及法律和道德伦理问题。这些问题需要得到认真对待,通过技术、政策和社会层面的努力来解决。

最后,计算能力和硬件发展是人工智能发展的重要驱动力之一,但其发展的步伐和方向也需要不断调整和优化。我们需要保持敏锐的眼光,抓住机遇,解决问题,以实现人工智能技术的可持续发展和应用。